반응형

지난 이야기

4번을 하다보니 쿠다 버전이 맞지 않는다는 에러가 뜸 사실 이땐 궁예였고 현 서버의 쿠다 버전을 몰라서(짐작으로는 10.1) 다시 설치를 못하고 있었는데 아침에 여쭤보니 역시 이 궁예가 맞았다!

아무튼 이걸 해결해 주시고 이제 with autocast(): 를 이용해 수정한 코드를 돌려보니 또 에러가 났다.

bash 코드부분을 살펴보니 vqa.py에서 loadLXMERTQA args을 딕셔너리로 불러와서 사용한다.

key 값을 확인해보니

이런 key들이 들어있는데 QA 모델이 아니라 pretrained lxmert 모델 자체로 불러와야 하는 것 같아서 이를 수정했다.

loadLXMERT --로!

그리고 loadLXMERT를 하면 뒤에 _LXRT.pth는 이후에 추가되어서 모델 자체의 이름만 넣어주면된다.

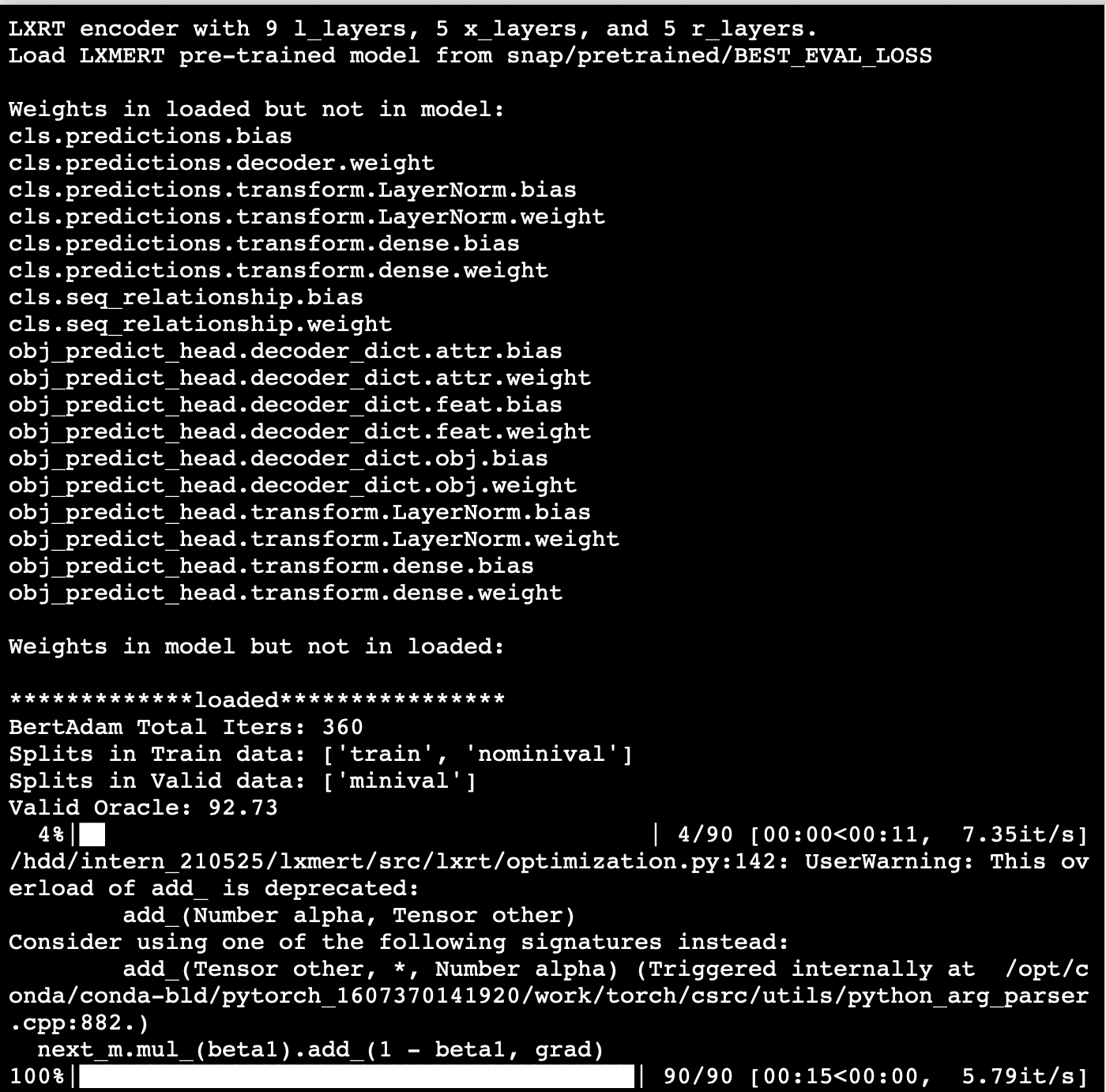

안쓰이는 weights가 있지만 이건 그닥 문제가 되지 않는듯🧐

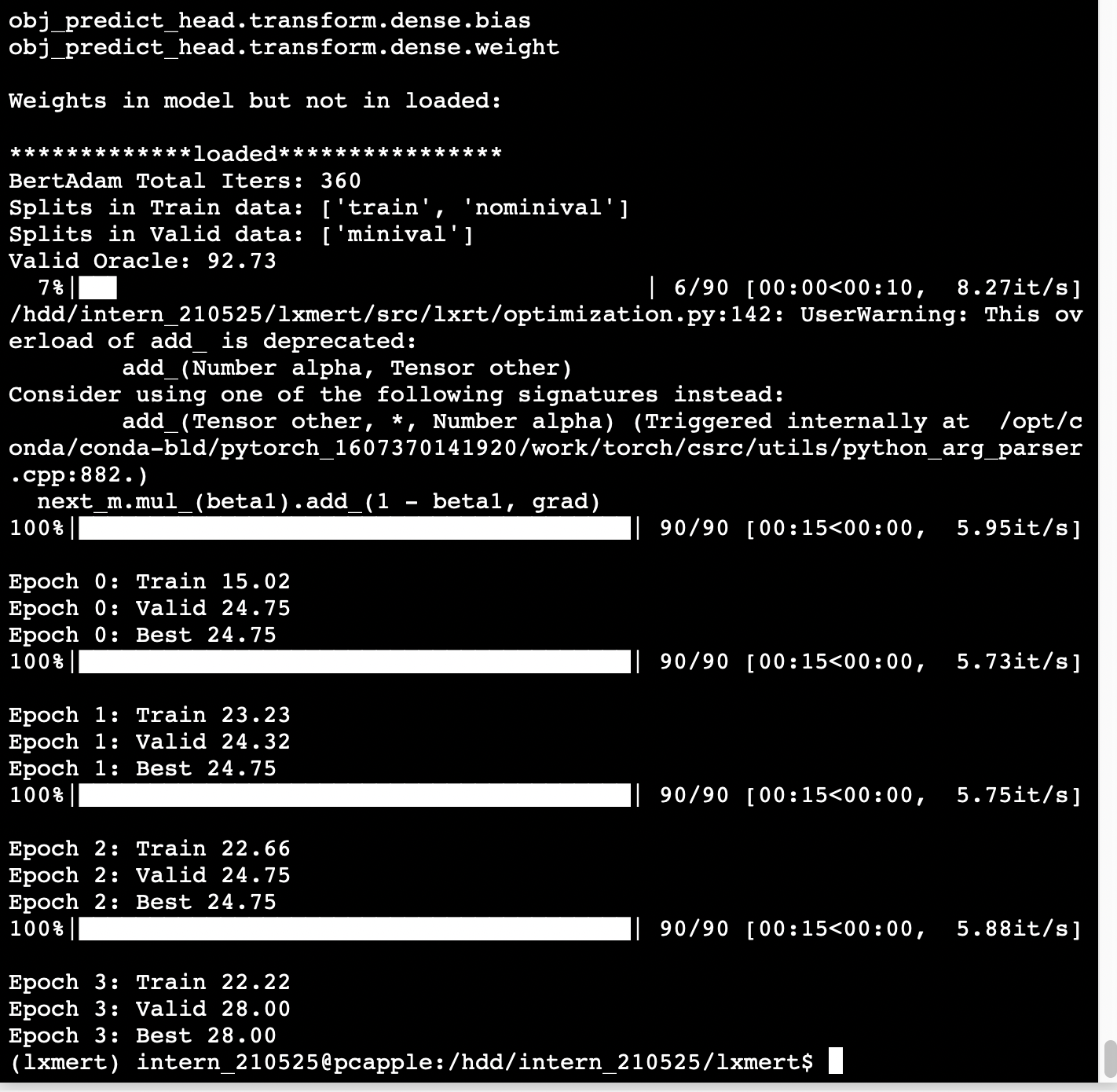

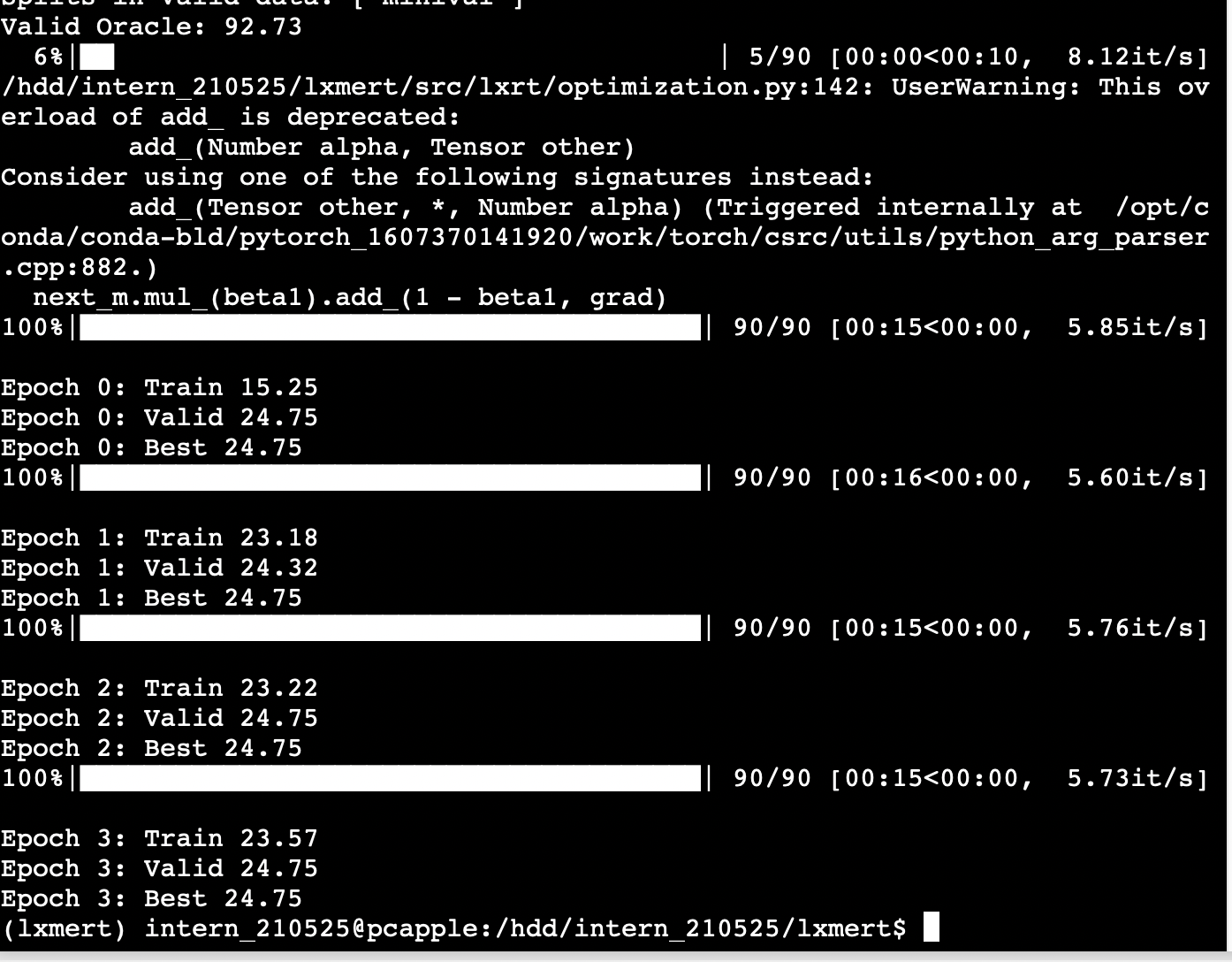

BEST_EVAL_LOSS_LXRT, model_LXRT, Epoch10_LXRT 순으로 돌아가는 것을 확인하였다.

지금은 에러없이 돌아가는지 확인해본 것이고 이제 5번 코드를 같은 순서대로 돌려보는 중이다.

한 모델당 8시간 정도 걸린다고 한다

오늘의 tmi] 사수분은 피카츄를 좋아하고 피카츄 이모티콘도 쓰지만 나에겐 한번도 쓰신적이 없다 ^-^ 칫

반응형

'Dobby is !free > Intern 🐣' 카테고리의 다른 글

| 인턴일지🥕 test_ma test_xlm* Epoch 1-4 * vqa gqa nvlr2 = 96hrs (0) | 2021.07.05 |

|---|---|

| 인턴일지 🥕 새로운 발견,, 이것을 로그라고 하자! 둥둥🥁🔥 (0) | 2021.06.27 |

| 인턴일지🥕 오랜만의 인턴일지와 여름방학 프로젝트 (0) | 2021.06.23 |

| 인턴일지🥕 드디어 결과가 나왔다! (0) | 2021.06.08 |

| 인턴일지🥕 이미지 전처ring..ring..💍.. (0) | 2021.05.05 |